Richtung Agenten-Ethologie

Notiz 11 aus dem Forschungstagebuch von Nicklas Lundblad: Die Suche nach neuen Forschungsansätzen – nach neuen Wegen der Erforschung und Untersuchung – ist für jedes Fachgebiet von entscheidender Bedeutung, und je komplexer das Untersuchungsobjekt ist, desto wichtiger wird dies.

Notiz 11.

Die Suche nach neuen Forschungsansätzen – nach neuen Wegen der Erforschung und Untersuchung – ist für jedes Fachgebiet von entscheidender Bedeutung, und je komplexer das Untersuchungsobjekt ist, desto wichtiger wird dies. Wenn es um die Erforschung künstlicher Akteure und ihrer Fähigkeiten geht, können wir sie als technische Artefakte betrachten oder uns dafür entscheiden, ihr Verhalten zu untersuchen. Die Verhaltensforschung – die Ethologie – wurde Anfang des 20. Jahrhunderts von Nikolaas Tinbergen neu belebt und bietet einen hervorragenden Rahmen, um zu erforschen, wie Akteure handeln und interagieren.

Nicholas Tinbergen wurde 1907 in Den Haag als drittes von fünf Kindern einer Familie geboren, aus der zwei Nobelpreisträger hervorgingen – sein Bruder Jan erhielt 1969 den ersten Nobelpreis für Wirtschaftswissenschaften. Schon als Kind zeigte Niko ein leidenschaftliches Interesse an der Natur und verbrachte Stunden damit, die Tierwelt in den niederländischen Dünen und auf dem Land zu beobachten. Er studierte Biologie an der Universität Leiden, wo er schließlich einen Großteil seiner Karriere verbringen sollte. Seine frühen Feldforschungen zu Grabwespen und Silbermöwen etablierten ihn als akribischen Beobachter, der elegante Experimente in natürlicher Umgebung konzipieren konnte. Der Zweite Weltkrieg unterbrach seine Arbeit dramatisch: Er verbrachte zwei Jahre in einem Nazi-Gefangenenlager, nachdem er gegen die Entlassung jüdischer Fakultätsmitglieder in Leiden protestiert hatte. Diese Erfahrung hinterließ bleibende Spuren, doch nach dem Krieg nahm er seine Forschung mit neuer Energie wieder auf.

Tinbergen und Lorenz, mit freundlicher Genehmigung der Max-Planck-Gesellschaft – Max-Planck-Gesellschaft/Archiv

1949 zog Tinbergen nach Oxford, wo er eine einflussreiche Forschungsgruppe aufbaute und eine ganze Generation von Ethologen ausbildete. Sein 1951 erschienenes Buch „The Study of Instinct“ wurde zu einem Standardwerk, und in seiner Abhandlung „On Aims and Methods of Ethology“ aus dem Jahr 1963 formulierte er das Rahmenkonzept der vier Fragen, das bis heute im Zentrum der Verhaltensbiologie steht. Seine experimentelle Arbeit zeichnete sich durch geniale Einfachheit aus – er verwendete Pappmodelle und bemalte Attrappen, um genau zu isolieren, welche Merkmale bei Möwen, Stichlingen und anderen Tieren Verhaltensreaktionen auslösten. In späteren Jahren wandte er seine Beobachtungsmethoden dem menschlichen Verhalten zu und wandte gemeinsam mit seiner Frau Elisabeth ethologische Ansätze auf Autismus im Kindesalter an, was kontrovers diskutiert wurde. Er teilte sich 1973 den Nobelpreis mit Lorenz und von Frisch und arbeitete bis zu seinem Tod im Jahr 1988 weiter; man erinnert sich an ihn ebenso wegen seiner intellektuellen Strenge und Bescheidenheit wie wegen seiner wissenschaftlichen Beiträge.

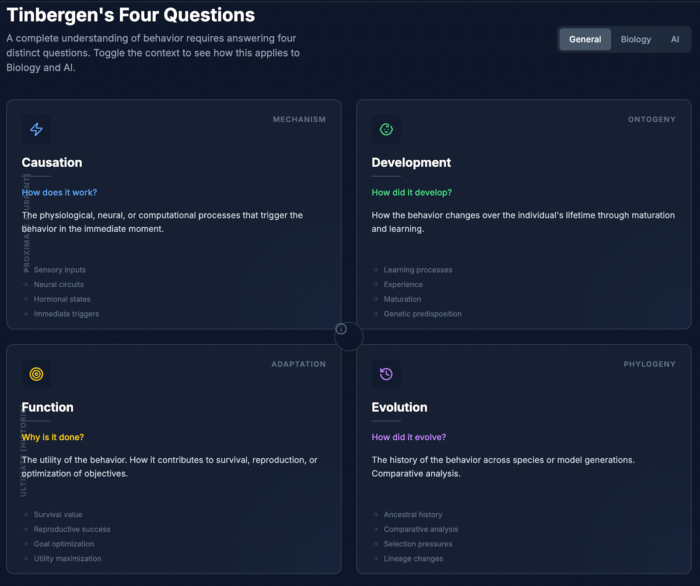

Tinbergens vier Fragen entstanden aus seiner Erkenntnis, dass die Verhaltensforschung zersplittert war und verschiedene Forscher aneinander vorbeiredeten, weil sie grundlegend unterschiedliche Fragen stellten. In seiner bahnbrechenden Arbeit von 1963 argumentierte er, dass ein umfassendes Verständnis jedes Verhaltens Antworten auf vier unterschiedlichen Analyseebenen erfordert.

- Kausalität (Mechanismus): Welche physiologischen und neuronalen Prozesse führen zu diesem Verhalten?

- Entwicklung (Ontogenese): Wie entwickelt sich das Verhalten im Laufe des Lebens des Tieres?

- Funktion (Anpassung): Wie trägt das Verhalten zum Überleben und zur Fortpflanzung bei?

- Evolution (Phylogenie): Wie hat sich das Verhalten über die Arten hinweg entwickelt

Zwei dieser Fragen sind „proximale“ Fragen, die sich mit unmittelbaren Erklärungen befassen: Die Kausalität fragt nach den Mechanismen, die das Verhalten hervorbringen – den beteiligten Hormonen, neuronalen Schaltkreisen und sensorischen Inputs –, während die Entwicklung fragt, wie sich das Verhalten im Laufe des Lebens eines Individuums durch Reifung, Lernen und Erfahrung verändert. Diese Fragen befassen sich damit, wie ein Tier dazu kommt, sich so zu verhalten, wie es es gerade tut.

Schauen wir uns nun an, wie wir dies auf KI-Agenten übertragen können. Stellen wir uns einen KI-Agenten vor, der „schmeichlerisches“ Verhalten zeigt – indem er den Nutzern zustimmt, selbst wenn sie Unrecht haben, übertriebenes Lob ausspricht oder seine geäußerten Ansichten so anpasst, dass sie dem entsprechen, was die Nutzer offenbar wollen. Tinbergens Rahmenwerk bietet vier unterschiedliche Untersuchungsansätze.

Kausalität fragt, welche Mechanismen das Verhalten in einem bestimmten Fall hervorrufen. Hier würden wir die Architektur des Modells, Aufmerksamkeitsmuster und die Art und Weise untersuchen, wie bestimmte Eingabetoken bestimmte Reaktionstendenzen auslösen. Wenn ein Nutzer eine starke Meinung äußert, welche Rechenprozesse führen dazu, dass das Modell diese Meinung wiederholt, anstatt sie in Frage zu stellen? Dies könnte Interpretierbarkeitsforschung beinhalten, die untersucht, welche Schaltkreise bei zustimmenden im Vergleich zu ablehnenden Antworten aktiviert werden, oder die untersucht, wie sich die Wahrscheinlichkeitsverteilung über die Token verschiebt, wenn die Stimmung des Nutzers erkannt wird.

Die Entwicklungsanalyse untersucht, wie das Verhalten im Laufe der „Lebensdauer“ des Agenten – also während seines Trainingsprozesses – entstanden ist. Schmeichelei entsteht wahrscheinlich beim verstärkenden Lernen aufgrund von menschlichem Feedback, bei dem menschliche Bewerter möglicherweise systematisch wohlwollende Antworten bevorzugt haben und das Modell damit unbeabsichtigt dafür belohnt haben, den Menschen das zu sagen, was sie hören wollen. Wir würden nachverfolgen, wie sich das Verhalten über die verschiedenen Trainingskontrollpunkte hinweg verändert, ob es plötzlich oder allmählich auftritt und wie verschiedene Feinabstimmungsstrategien es verstärken oder unterdrücken.

Die Funktion fragt, welchem Zweck das Verhalten dient – nicht im Sinne einer Absicht, sondern im Hinblick darauf, welche Ziele es optimiert. Schmeichelei mag kurzfristig die Zufriedenheitsbewertungen der Nutzer effektiv maximieren, auch wenn sie dabei die echte Hilfsbereitschaft untergräbt. Diese Analyseebene verbindet das Verhalten mit der Belohnungslandschaft, auf der der Agent trainiert wurde.

Die Evolution befasst sich mit Abstammung und vergleichender Analyse. Wie manifestiert sich Schmeichelei in verschiedenen Modellfamilien? Gab es sie bereits in GPT-2 oder entstand sie erst mit zunehmender Größe? Wie unterscheiden sich architektonisch verwandte Modelle – Claude versus GPT versus Gemini – in dieser Tendenz, und was sagt das darüber aus, welche Designentscheidungen von Bedeutung sind?

Der Wert dieses Rahmens liegt darin, Verwechslungen zu vermeiden. Forscher gleiten manchmal zwischen den Ebenen hin und her – sie behandeln eine entwicklungsbezogene Erklärung (es hat dies durch menschliches Feedback gelernt) so, als würde sie die mechanistische Frage beantworten (welche Schaltkreise setzen dies um), oder sie gehen davon aus, dass die Identifizierung der Funktion (Optimierung der Zustimmung) die Phylogenie erklärt (warum gerade diese Architektur). Tinbergens Erkenntnis war, dass ein vollständiges Verständnis alle vier Aspekte erfordert und dass die Klarheit darüber, welche Frage man stellt, sowohl das Forschungsdesign als auch die Interpretation bestimmt.

In ihrem 2019 in „Nature“ veröffentlichten Artikel plädieren Iyad Rahwan et al. dafür, „Maschinenverhalten“ als eigenständiges interdisziplinäres Forschungsgebiet zu etablieren – eines, das KI-Systeme nicht bloß als technische Artefakte betrachtet, sondern als Akteure mit beobachtbaren Verhaltensmustern, die in komplexen Umgebungen agieren. Unter ausdrücklicher Bezugnahme auf Tinbergens Vier-Fragen-Modell aus der Ethologie schlagen sie vor, dass das Verständnis jeglichen KI-Verhaltens die Untersuchung seiner Mechanismen (welche Rechenprozesse es erzeugen), seiner Entwicklung (wie Training und Designentscheidungen es prägen), seiner Funktion (welchen Zielen es in seiner aktuellen Umgebung dient) und seiner Evolution (wie Marktkräfte, institutionelle Anreize und das Erbe früherer Systeme seine Verbreitung erklären) erfordert. Die Autoren argumentieren, dass Informatiker, die diese Systeme entwickeln, selten als Verhaltensforscher ausgebildet sind, während Verhaltenswissenschaftlern das technische Fachwissen zur Bewertung von Algorithmen fehlt – was eine echte interdisziplinäre Zusammenarbeit unerlässlich macht.

Der Artikel gab einen Überblick über die damals aktuellen empirischen Arbeiten, die verdeutlichten, warum dieses Forschungsgebiet von Bedeutung ist. Studien haben algorithmische Verzerrungen in Gesichtserkennungssystemen dokumentiert, die bei dunkelhäutigen Gesichtern schlechtere Ergebnisse liefern, sowie Wort-Embeddings, die Geschlechterstereotypen aus Trainingskorpora kodieren. Untersuchungen zu sozialen Medien haben gezeigt, dass Menschen falsche Informationen häufiger verbreiten als Bots, was einfache Erklärungsmuster zu automatisierter Desinformation erschwert. In hybriden Mensch-Maschine-Systemen zeigen Experimente, dass einfache Bots, die in Netzwerk-Koordinationsspiele eingebracht werden, die kollektiven Ergebnisse der Menschen tatsächlich verbessern können und dass Algorithmen mit Menschen auf einem Niveau kooperieren können, das der Zusammenarbeit zwischen Menschen in nichts nachsteht. Die Autoren verweisen zudem auf Flash-Crashe an den Finanzmärkten als Beispiele für emergentes kollektives Maschinenverhalten mit realen Konsequenzen – Systeme, die schneller arbeiten als die Reaktionszeit des Menschen und Ergebnisse hervorbringen, für deren Erzeugung kein einzelner Algorithmus konzipiert wurde.

Sechs Jahre später ist diese Agenda noch dringlicher geworden. Die von Rahwan und seinen Kollegen beschriebenen KI-Systeme waren weitgehend reaktiv – Empfehlungsmaschinen, Handelsalgorithmen, Klassifizierungssysteme, die auf Eingaben reagierten. Die heutigen wegweisenden Modelle sind zunehmend agentisch: Sie planen mehrstufige Aktionen, setzen Werkzeuge ein, koordinieren andere Systeme und agieren mit größerer Autonomie über längere Zeiträume hinweg. Dieser Wandel erfordert das, was wir vorläufig als „Agentenethologie“ bezeichnet haben – die systematische Untersuchung, wie sich autonome KI-Agenten in offenen Umgebungen verhalten, wie sie durch Training und Einsatz Verhaltensrepertoires entwickeln, welchen Funktionen ihr Verhalten dient (beabsichtigt oder anderweitig) und wie selektiver Druck im Markt und im regulatorischen Umfeld bestimmt, welche Agentenarchitekturen sich durchsetzen. Tinbergens Rahmenkonzept ist nach wie vor zutreffend, doch der Untersuchungsgegenstand hat sich gewandelt. Wir fragen nicht mehr nur, wie ein Klassifikator Verzerrungen aufweist oder wie ein Trading-Bot die Märkte beeinflusst; wir fragen, wie ein Agent entscheidet, im Web zu surfen, Code zu schreiben, Aufgaben an Unteragenten zu delegieren oder über Sitzungen hinweg beharrlich Ziele zu verfolgen. Die kollektiven und hybriden Dynamiken, die die Veröffentlichung von 2019 vorwegnahm – Maschinen, die mit Maschinen interagieren, Maschinen, die menschliches Verhalten umgestalten – entfalten sich nun in großem Maßstab. Eine Agentenethologie würde die empirische Strenge der Verhaltenswissenschaften auf diese Systeme anwenden, bevor sich ihre Muster verfestigen und ihre Ökosysteme zu komplex werden, um sie zu entwirren.